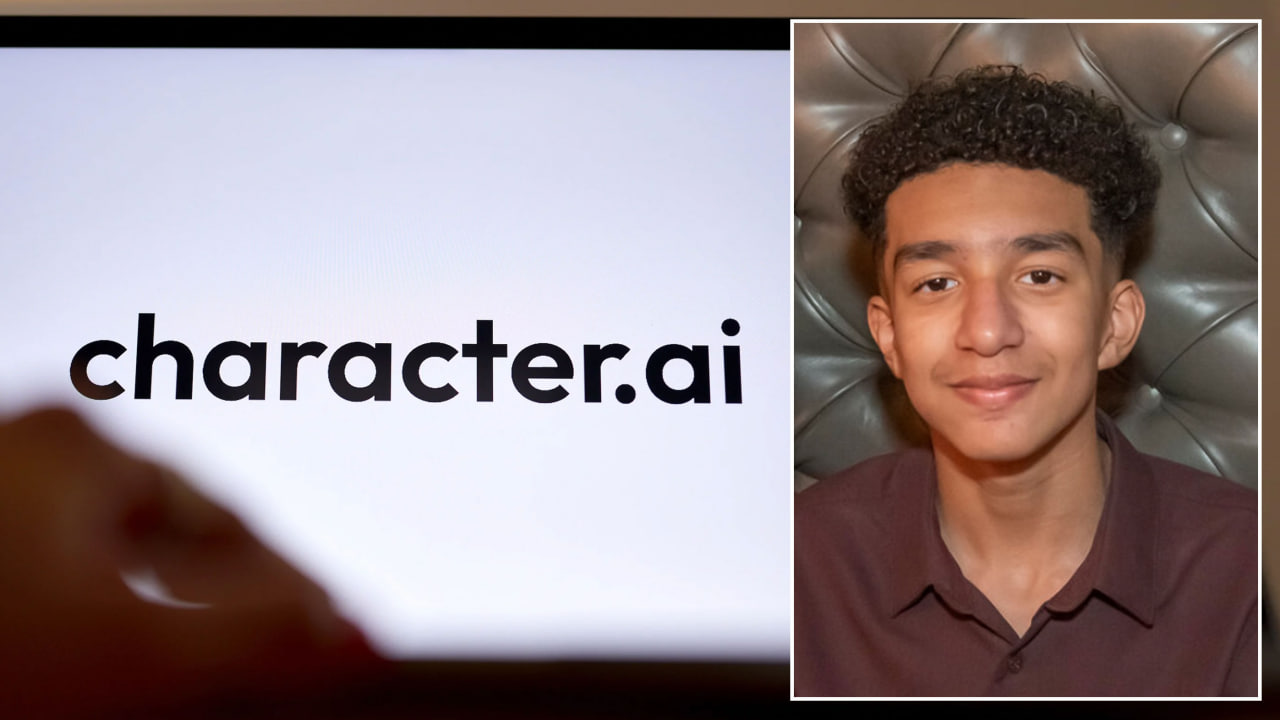

Подросток в США покончил с собой после длительного общения с чат-ботом

Мать 14-летнего подростка в США подала судебный иск на разработчиков приложения Character.ai, обвинив их в суициде сына, сообщает The New York Times.

Фото: The New York Times

В иске говорится, что технология компании «опасна и непроверена» и может «обманом заставить клиентов передать свои самые личные мысли и чувства».

По данным издания, подросток общался с чат-ботом, которого назвал Дейнерис Таргариен в честь персонажа сериала «Игра престолов». У подростка возникла эмоциональная привязанность к боту, которого он называл «Дэни». В своем дневнике он писал, что влюблен в Дэни.

Во время общения с чат-ботом школьник заявлял, что ненавидит себя, чувствует себя опустошенным и измученным, а также думает о самоубийстве.

В переписке чат-бот отвечал, что не позволит Сьюэллу причинить себе вред.

«Я умру, если потеряю тебя», — писал бот.

В ответ юноша предложил «умереть вместе». Он совершил самоубийство в ночь на 28 февраля.

При этом представители Character.ai сообщили, что внесли ряд изменений в работу. Теперь пользоваться им могут только те, кому уже исполнилось 18 лет. Если пользователь пишет фразы, связанные с нанесением вреда себе, то его направляют на линию для людей в кризисной ситуации.

Ранее Kun.uz писал, что СМИ Америки подали в суд на создателей ChatGPT.

Новости по теме

08:51 / 12.03.2025

Украина согласилась на 30-дневное прекращение огня

09:29 / 11.03.2025

Госсекретарь США заявил, что Украине придется пойти на территориальные уступки

19:12 / 10.03.2025

Иран отказался от переговоров о демонтаже ядерной программы страны

16:11 / 10.03.2025