Har oqshomdagi kabi ekranda suxandon Kim Ju-Xa paydo bo‘ladi va u odamlarni yangiliklardan boxabar qilishga kirishadi. 2020 yilgi kun tartibiga muvofiq, yangiliklarning aksariyati Covid-19 epidemiyasi va unga qarshi kurash haqida edi.

Ammo shunga qaramay, ushbu axborot ko‘rsatuvi odatdagidan mutlaqo boshqacha edi, chunki ekrandagi inson, aslida, Kim Ju-Xa emasdi. Uning o‘rniga ushbu suxandonning deepfake texnologiyasi bilan yaratilgan versiyasi yangiliklarni o‘qib eshittirayotgan edi. Kompyuter texnologiyasi yordamida ishlab chiqarilgan «soxta» suxandon ovoz, mimika va tabassumlarni mukammal tarzda takrorlayotgandi.

Tomoshabinlar avvalroq ushbu shou haqida ogohlantirilgandi. Keyingi tadqiqotlar shuni ko‘rsatadiki, tinglovchilar bu holga nisbatan turlicha munosabat bildirishgan. Ba'zilar chindan ham hayratda ekanini, ba'zilar esa haqiqiy Kim Ju-Xaning ishdan ayrilib qolishidan xavotirlanayotganini ta'kidlaydi.

MBN kanali ba'zi tezkor yangiliklarda deepfake texnologiyasidan foydalanishda davom etishini ma'lum qildi. Ushbu texnologiyani ishlab chiqaruvchilaridan biri – Janubiy Koreyaning Moneybrain kompaniyasi yangi sheriklik imkoniyatlari uchun Xitoy va AQSh bilan aloqalar o‘rnatilishini e'lon qildi.

Deepfake texnologiyasi deganda, odatda, ko‘pchilikning aqliga mashhur insonlar haqidagi videolar keladi. O‘tgan hafta Tom Kruzning munosabati aks etgan soxta video TikTok ilovasiga joylashtirilganidan so‘ng butun dunyo diqqat-eʼtiborini jalb qildi.

Umumiy foydalanishda bo‘lgan deepfake texnologiyasi e'tirozlarga qaramay (odamlar yolg‘on bilan to‘qnash kelishni istashmaydi), tijoriy maqsadlar yo‘lida tobora ko‘proq qo‘llanmoqda.

«Bu – kontent yaratishning kelajagi»

Sektor tilida «sun'iy intellekt yordamida ishlab chiqariluvchi videolar» yoki «sintetik media» deb nomlanuvchi ushbu texnologiya yangiliklar, ko‘ngil ochish va ta'lim sohalarida katta qiziqish uyg‘otmoqda. Albatta, bunga mazkur texnologiyaning kundan kunga rivojlanib borayotgani ham o‘z ta'sirini o‘tkazmoqda.

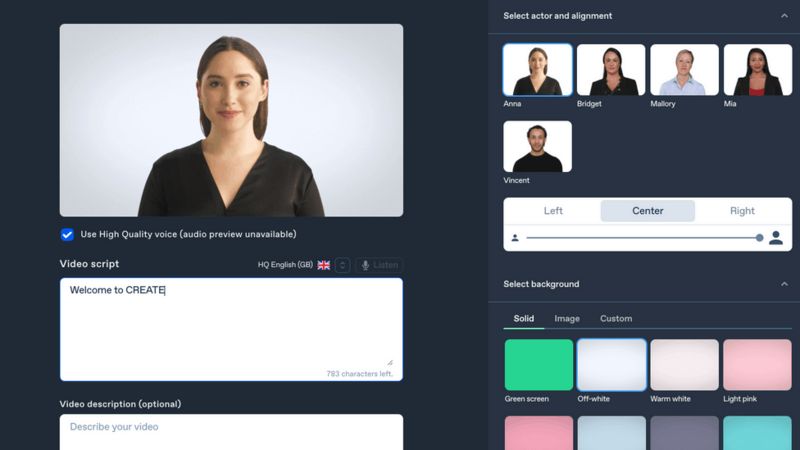

Londondagi Synthesia kompaniyasi ushbu texnologiyani firmaning ichki o‘quv videolarida foydalanish uchun sotmoqda.

«Bu – kontent yaratishning kelajagidir», deydi firma asoschilaridan biri Viktor Riparbelli.

Synthesia tizimida turli avatar variantlar mavjud bo‘lib, yetkazilmoqchi bo‘lgan xabar yozilsa, ularning javobini olish mumkin.

Riparbellining ta'kidlashicha, shu tariqa global kompaniyalar ta'lim jarayonida foydalanish uchun turli tillardagi videolarni juda osonlik bilan tayyorlashlari mumkin.

«Aytaylik, Shimoliy Amerikada omborda ishlovchi 3 ming nafar ishchingiz bor. Ularning ba'zilari ingliz tilida gaplashadi, ba'zilari esa ispan tilini yaxshi bilishadi. Agar ular bilan axborot almashmoqchi bo‘lsangiz, to‘rt sahifadan iborat pdf ma'lumotni ularning oldiga qo‘yishning o‘zi yetarli bo‘lmaydi. Bunday vaziyatda ingliz va ispan tillaridagi 3 daqiqalik videorolik nisbatan samarali bo‘lishi mumkin.

Agar siz o‘sha videolarning har birini suratga olishga majbur bo‘lsangiz, bu ham iqtisodiy jihatdan qimmatga tushadi, ham bajariladigan ish hajmi nuqtayi nazardan ko‘p mehnatni talab qiladi. Endi biz buni kam xarajat evaziga, matn yozish uchun talab qilinadigan vaqt davomida bajarish imkoniyatiga egamiz. Bu – bugungi kunda texnologiyadan qanday foydalanilayotganining yorqin misoli bo‘la oladi», deydi u.

Biroq, Veritone sun'iy intellekt texnologiyalari kompaniyasi menejyeri Chad Stilbergning ta'kidlashicha, deepfake’dan yomon niyatda foydalanish bilan bog‘liq xavotirlar undan qonuniy foydalanish uchun sarmoya kiritmoqchi bo‘lgan kompaniyalarni ortga qadam tashlashga majbur qilmoqda.

«Biz holat kompaniya va investorlarning ushbu texnologiyaga «yopishib» olishlariga to‘sqinlik qilayotgan bo‘lsa-da, mazkur texnologiyaga qiziqish ortishi natijasida bu kayfiyat o‘zgarib bormoqda», deydi Stilberg deepfake’ning investitsiya sohasida oqsayotganiga izoh berar ekan.

Boshqa bir sun'iy intellekt texnologiyalari firmasi – Modulate direktori Mayk Papas ham deepfake va u bilan bog‘liq etik qoidalar bo‘yicha qizg‘in bahslar bo‘layotgani va odamlar bu haqda bosh qotirishda davom etayotganini ta'kidlaydi.

Papasning aytishicha, texnologiyadan foydalanishning etik jihatlari bo‘yicha tadqiqotlar ortib borishi bilan investorlarning ishonchi ham ortmoqda.

«Deepfake: nima qilish kerak?»

Deepfake texnologiyasiga ixtisoslashgan yuridik fanlar professori Lilian Edvards esa masalaning boshqa bir muhim jihati – videolarga bo‘lgan huquqlar kimga tegishli ekaniga e'tibor qaratadi.

Edvards bu boradagi fikrini quyidagicha ifoda etadi: «Agar bunday videoda aktyor Stiv Makkuin yoki rep yulduzi Tupakdan mana shunday bir videoda foydalanilsa, u holda oila undan daromad olishga haqlimi yoki yo‘q? Bu boradagi munozaralar davom etmoqda. Fikrlar esa turli mamlakatda turlicha».

Virjiniya universitetining etika professori Debora Jonson yaqinda «Deepfake: nima qilish kerak?» nomli kitob yozdi. Uning fikricha, deepfake – bu institutlar va vizual tajribalarga bo‘lgan ishonchni kamaytiruvchi, shuningdek, «noto‘g‘ri ma'lumot tarqatish» muammosining bir qismidir.

Biz endi ko‘rgan va eshitgan narsalarimizga ishonmaymiz», deydi Debora Jonson. Uning fikricha, deepfake texnologiyasidan foydalangan holda yaratilgan videolarni e'lon qilishdan oldin ular soxta ekani aytilishi lozim. Bu bilan tomoshabinlarni himoya qilish mumkin.

Oksford universiteti professori Sandra Vaxter ham deepfake texnologiyasi tobora rivojlanib borayotganini ta'kidladi: «Agar siz o‘tgan hafta Tom Kruz videosini tomosha qilgan bo‘lsangiz, ushbu texnologiyaning qanchalik rivojlanganini ko‘rishingiz mumkin. Bu to‘rt yil oldingi Obamaning videosiga qaraganda ancha realroq edi. Biz ushbu texnologiyadan ko‘p ham qo‘rqmasligimiz va unga mutanosib ravishda yondashishimiz kerak. Ha, yomon va xavfli narsalarga qarshi turuvchi qonunlar bo‘lishi lozim. Ammo hajv yoki so‘z erkinligi doirasida yaratilgan deepfake videolarga qat'iyan taqiq qo‘ymasligimiz darkor.

Sun'iy intellektga asoslangan videolardan ta'lim maqsadida foydalanilishiga oid misollardan biri Kaliforniya universiteti Genotsid fondi tomonidan keltirildi.

Genotsiddan omon qolgan 55 mingdan ziyod kishining guvohligini taqdim etgan mazkur fond mehmonlar va genotsiddan omon qolganlarni deepfake texnologiyasi yordamida birlashtiradi.

«Dalillarning o‘lchami» deb nomlangan mazkur loyihada mehmonlar tomonidan berilgan savollarga genotsiddan omon qolgan va ilgari intervyu olingan insonlarning tezkor javob berishi ta'minlanadi.

Veritone menejyeri Chad Stilbergning ta'kidlashicha, kelajakda ushbu texnologiyadan foydalangan holda avlodlar avval yashab o‘tgan o‘z ajdodlari bilan suhbatlashishlari mumkin.

«Jamiyat nuqtayi nazardan olib qaraganda, bu inqilobiy xaraktega ega», deydi Stilberg.